Meine Kollegin Sarah Kriesche berichtet auf Ö1 und FM4 seit vielen Jahren über Internet-Themen. Sie hat mir heute ein langes Mail geschrieben, in dem sie die aktuelle Aufregung um Cambridge-Analytica aufdröselt, die Facebook in den letzten Tagen in die tiefste Krise seiner Existenz gestürzt hat. Dieses Mail erklärt die Affäre und ihre Hintergründe so gut, dass ich Sarah Kriesche um die Erlaubnis gebeten habe, ihren Text hier online zu stellen. Es wäre schade, könnte nur ich ihn lesen.

Das, was Facebook an User-Daten sammelt, ist der ursprüngliche Grund, weshalb Max Schrems seinerzeit vor Gericht gezogen war. Unter anderem waren in seinen Dokumenten Passagen mit dem Zusatz versehen gewesen, der User (Max Schrems) habe diesen Teil gelöscht. Sprich: Facebook hatte damals versehentlich öffentlich gemacht, dass wir zwar Inhalte löschen können – aber das bedeutet nur, dass wir selbst sie nicht mehr sehen. Das Unternehmen behält die Daten dennoch.

Diese Masse an Daten, von der Freundschaftsanfrage bis hin zum Telefonat oder privaten Chat, sind sozusagen der Treibstoff, damit Künstliche Intelligenz (KI) zu Hochform auflaufen kann. Dank KI ist es möglich, die Daten in Windeseile zu ordnen, zu kategorisieren und Vorhersagen zu treffen: Was werden wir kaufen? Wen werden wir wählen? Kann man das beeinflussen?

Facebook-User sind, wenn man es so sehen will, Teil eines riesigen Forschungsexperiments. Gesichtserkennung, selbstfahrende Autos, „smarte“ Assistenten, die auf unsere Sprache reagieren: All diese selbstlernenden Systeme brauchen jede Menge Training anhand von Beispiel-Daten, um zu funktionieren. Und das Social Media-Disneyland soll uns dazu animieren, Trainingsdaten zu produzieren.

WIE WIR – OHNE ES ZU WISSEN – ROBOTER TRAINIEREN

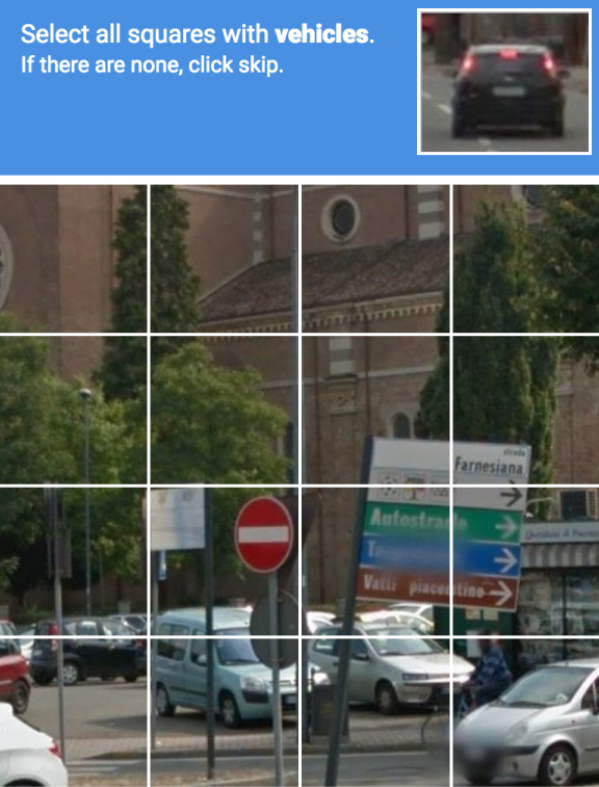

Sie kennen sicher diese „Captchas“ – eine Website sagt, sie müsse sicherstellen, dass man kein Bot ist und man bekommt eine Bilderreihe und soll anklicken, wo z.B. eine Ampel zu sehen ist, bis man zum Inhalt weitergeleitet wird. Hier wird eine spezifische Künstliche Intelligenz trainiert – in diesem Fall wohl selbstfahrende Autos. Unser Wissen soll dem Algorithmus helfen, Ampeln zu erkennen. Kurzum: Die Forschung, die das Unternehmen betreibt, wird durch uns ermöglicht. Weshalb eine tatsächliche Änderung der Zustände das eigene Geschäftsmodell zerstören würde.

Cambridge Analytica, um die es in der aktuellen Affäre geht, betreibt nur eine von vielen Apps, die am Datenkuchen mitnaschen. Ein verführerischer Name, da viele Menschen an die gleichnamige Universität dachten und der App deshalb wohl mehr vertrauten. „Wie gut kennst du deine Freunde?“ „Was für ein Farbtyp bist du?“ – diese Selbsttests waren die Ausgangsbasis, um psychologische Profile zu erstellen, die man im Trump-Wahlkampf nutzen wollte.

Wie auch bei Spielen wie „Farmville“ (das Unternehmen Zynga ist ein wahrer Experte) wird ausgenutzt, dass Userinnen und User einen konkreten Bedarf haben – „will das Spiel spielen“ – und sich nicht mit Freigaben aufhalten wollen. Eine Nicht-Einwilligung würde auch zumeist verhindern, dass man die App downloaden oder das Quizz machen kann. Also willigten alle mehr oder weniger ein, dass sämtliche Daten, Inhalte, Freundschaften usw. auch an Cambridge Analytica weitergegeben werden dürfen. Die haben das für ihre Zwecke – in diesem Fall den Trump Wahlkampf – benutzt.

FÜR FACEBOOK NICHTS NEUES

Facebook gibt sich verwundert, dass Cambridge Analytica die erhaltenen Daten separat abgesaugt und behalten und nicht gelöscht hat und findet das nun verwerflich und unethisch – etwas, das sich im Gerichtsverfahren bei Max Schrems 2011 noch anders gelesen hatte. Damals argumentierte Facebook sinngemäß: So läuft das Geschäft – nütze das alles halt nicht, wenn es dir nicht passt.

Heute zu sagen, „Wir wussten nicht“ ist also nicht sehr glaubwürdig. Positiv ist hingegen, dass sich offenbar das gesellschaftliche Bewusstsein verändert hat und das Facebook-Argument „Mein Haus, meine Regeln“ so nicht mehr durchgeht und mittlerweile geschäftsschädigend wäre, weshalb das Unternehmen jetzt zurückrudert und an einer Art Kompromiss arbeitet.

Das Prinzip des Microtargeting ist nicht neu – es ist vielmehr das Prinzip, warum das World Wide Web so schön ist, wie wir es derzeit kennen. Maßgeschneiderte Werbung ist quasi die Säule, die dieses Protokoll trägt. Sprich: Dass wir chatten, surfen, Musik hören etc. – und das so oft vermeintlich kostenlos –, ist nur möglich, weil wir im Ausgleich dafür Daten von uns hinterlassen und optimierte Werbung bekommen.

WIE WIR – OHNE ES ZU MERKEN – VERSTEIGERT WERDEN

Wenn Sie eine Website öffnen, um einen Inhalt zu lesen, geht es im Hintergrund zu, wie auf einem Bazar: Eine (automatisierte) Auktion beginnt: „Achtung, Achtung, alle herhören – eine Person, die wir auf 35-45 Jahre schätzen, männlich, gebildet, wahrscheinlich Hochschulabschluss, verheiratet, Schuhgröße 42, trägt gerne Jeans, öffnet die Website. Wer will Werbung schalten?“

Und dann melden sich ein paar tausend Anbieter, die Mikrobeträge zahlen und sich überbieten, damit Sie deren Inhalte blinken sehen. Den „Gewinner“ bekommen Sie dann tatsächlich als Werbung auf ihren Bildschirm. Das Ganze passiert im Bruchteil von Sekunden – wir merken es zumeist nicht. Aber so funktioniert das Prinzip, das sich schon lange etabliert hat. Neu – aber nicht überraschend – ist, dass diese Idee auch die Politik erreicht hat. Bereits im Obama-Wahlkampf war Microtargeting das Um und Auf.

ABER WIE BEEINFLUSSBAR SIND WIR?

Allerdings sollte man – so irritierend manch Aussage bei Cambridge Analytica auch war – die Macht nicht überschätzen. Es gibt bekanntlich nicht den einen Faktor, der unsere Entscheidungen prägt. Filme und Computerspiele, in denen zumeist der eine Held genau weiß, wie die Welt zu retten ist, haben genauso ihren Teil dazu beigetragen, dass uns die Idee vom „starken Mann“, der weiß, was das Beste ist und nicht lang rumdiskutiert, sondern einfach macht (wider alle demokratischen Prinzipien) nicht befremdlich erscheint. Es ist wie so oft ein Zusammenspiel.

Das grundlegende Problem ist, dass wir dem Datensammeln sämtlicher Unternehmen auf dem normativen Weg nie zugestimmt haben. Allerdings auf dem soziologischen, weil wir ja alle mitmachen, wodurch sich eine Kluft ergibt und der Staat, sowie die Demokratie drohen, ausgehöhlt zu werden.

DIE VERMEINTLICHE MACHT DER USER

Denn es sind Technologie-Giganten aus den USA, die die Datenmacht haben, die Welt mitgestalten und die bestimmen können, was auf ihren Plattformen auf welche Art gespielt wird. (Wir haben es also mittlerweile mit einem Macht-Duopol zu tun: Dem des Staates und dem von Technologie-Giganten.)

Um User hier nicht zu verunsichern, bedienen sich die Unternehmen eines Kniffs, der schon im Film „Die üblichen Verdächtigen“ gut funktionierte: Der größte Trick, den der Teufel je hatte, war, die Welt glauben zu lassen, es gibt ihn nicht. Wir kennen Mark Zuckerberg, aber er tritt nicht aktiv regulierend in Erscheinung. Das Bild, das uns Facebook, Twitter und Co vermitteln, sind vermeintlich wir als die Gestalterinnen und Gestalter der Timelines. Und neue Gadgets und Features sollen uns den Tag erleichtern und helfen, Zeit zu vertreiben.

Wer etwas Negatives wahrnimmt, kann es melden und es hat den Anschein, es läge ganz demokratisch an Userinnen und Usern, Content zu melden und dann würde er gelöscht. Wenn berühmte Gemälde bei Facebook einer gefühlten Zensur zum Opfer fallen, liegt das an den Experimenten, künstliche Intelligenz einzusetzen, die die Massen an Bildern durchforstet und bereits eigenmächtig löscht – eine der wenigen Momente, wo Facebook als Herrscher über die Plattform in Erscheinung tritt.

Die EU-Datenschutzgrundverordnung, die demnächst in Kraft tritt, soll zwar ihren Teil dazu beitragen, dass unsere Daten nicht mehr wie Freiwild behandelt werden, dem gegenüber stehen aber Geschäftsmodelle, die uns und unsere Daten brauchen, um in der Forschung und mit der „Next Generation AI“ (Artificial Intelligence) weiterzukommen.

WERDEN WIR WACHSAMER?

Das, was nun geschieht finde ich vor allem deshalb interessant, weil sich ein neues Bewusstsein etabliert zu haben scheint: Userinnen und User spüren zum ersten Mal, dass es große Anstrengungen gibt, sie und ihre Wahrnehmung zu manipulieren. In Folge entsteht vielleicht auch so etwas wie eine gefühlte Mitschuld an Entwicklungen, die vielleicht nicht in ihrem Interesse waren und sind. Auf jeden Fall ein wichtiger Schritt – weniger was das Schicksal von Facebook oder Cambridge Analytica angeht, sondern demokratischer Grundwerte willen.